Samba-1 Turbo erreicht 1000 t/s und übertrifft die Benchmark von Artificial Analysis

SambaNova Systems, das Unternehmen für generative KI-Lösungen mit den schnellsten Modellen und den fortschrittlichsten Chips, ist der klare Gewinner des neuesten Large Language Model (LLM) Benchmarks von Artificial Analysis. Mit über 1000 Token pro Sekunde (t/s) steht Samba-1 Turbo ganz oben auf dem Leaderboad und stellt damit einen neuen Rekord für die Leistung von Llama 3 8B auf.

Diese Pressemitteilung enthält multimediale Inhalte. Die vollständige Mitteilung hier ansehen: https://www.businesswire.com/news/home/20240529337451/de/

"SambaNova's Samba-1 Turbo has set a new record for large language model inference performance in recent benchmarking by Artificial Analysis." Micah Hill-Smith, Co-Founder CEO of Artificial Analysis. (Image source: Artificial Analysis)

"Unsere Mission ist es, jedem Unternehmen ein maßgeschneidertes KI-System zu einem geringeren Preis zu bieten", sagt Rodrigo Liang, CEO und Gründer von SambaNova. "Eine rasante Inferenzgeschwindigkeit, die keine Kompromisse bei der Genauigkeit eingeht, ist genau das, was Entwickler brauchen, um die Leistung eines personalisierten LLM in die Hände ihrer Organisation zu legen, um Arbeitsabläufe zu rationalisieren und Innovationen schneller umzusetzen."

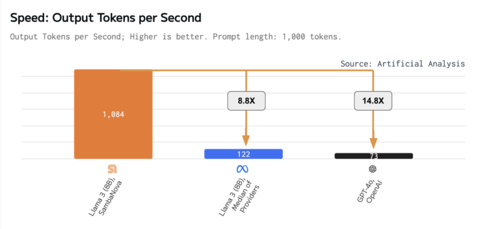

Micah Hill-Smith, Mitbegründer und CEO von Artificial Analysis, erklärte: "SambaNova's Samba-1 Turbo hat in einem kürzlich von Artificial Analysis durchgeführten Benchmarking einen neuen Rekord für die Inferenzleistung großer Sprachmodelle aufgestellt.

Artificial Analysis hat unabhängig die Leistung von Samba-1 Turbo auf Metas Llama 3 Instruct (8B) mit 1.084 Ausgabe-Token pro Sekunde gemessen. Das ist mehr als 8 Mal schneller als die durchschnittliche Ausgabegeschwindigkeit aller von uns getesteten Anbieter. Artificial Analysis hat bestätigt, dass Llama 3 Instruct (8B) auf Samba-1 Turbo Qualitätswerte erreicht, die der 16-Bit-Präzision entsprechen.

Neue Grenzen bei der Geschwindigkeit der Sprachmodellinferenz eröffnen neue Wege bei der Entwicklung von KI-Anwendungen. Zu den aufkommenden Anwendungsfällen gehören Agenten, die mehrstufige Aktionen ausführen und dabei eine nahtlose Konversation aufrechterhalten, Spracherlebnisse in Echtzeit und die Interpretation großer Mengen von Dokumenten."

Im Gegensatz zu Wettbewerbern, die dasselbe Modell auf Hunderten von Chips betreiben, führt Samba-1 Turbo Llama 3 8B mit 1000 Token pro Sekunde (t/s) auf nur 16 Chips aus und kann gleichzeitig bis zu 1000 Llama3-Checkpoints auf einem einzigen SN40L-Node mit 16 Sockeln hosten. Das ist die schnellste Geschwindigkeit, mit der Llama 3 bedient werden kann, und das bei voller Präzision und zu viel niedrigeren Kosten als bei der Konkurrenz. Der nächste Konkurrent benötigt aufgrund der begrenzten Speicherkapazität Hunderte von Chips, um eine einzige Instanz jedes Modells auszuführen, und GPUs bieten einen geringeren Gesamtdurchsatz und eine geringere Speicherkapazität. SambaNova kann Hunderte von Modellen auf einem einzigen Node ausführen und dabei diese Rekordgeschwindigkeit beibehalten, was zu 10-mal niedrigeren Gesamtbetriebskosten als bei der Konkurrenz führt.

"Die Geschwindigkeit von Samba-1 Turbo zeigt die Schönheit des Dataflow, der die Datenbewegung auf SN40L-Chips rationalisiert, die Latenzzeit minimiert und den Verarbeitungsdurchsatz maximiert. Es ist der GPU überlegen das Ergebnis ist sofortige KI", sagte Kunle Olukotun, Mitbegründer von SambaNova Systems und renommierter Computerwissenschaftler an der Stanford University.

Testen Sie Samba-1 Turbo noch heute!

Über SambaNova Systems

Kunden wenden sich an SambaNova, um schnell hochmoderne KI-Funktionen zu implementieren und die Anforderungen der KI-fähigen Welt zu erfüllen. Unsere maßgeschneiderte KI-Plattform für Unternehmen ist das technologische Rückgrat für die nächste Generation von KI-Computing. Wir ermöglichen es unseren Kunden, die wertvollen Geschäftseinblicke, die in ihren Daten stecken, zu erschließen. Unser Flaggschiff, die SambaNova Suite, überwindet die Grenzen der alten Technologie, um die großen, komplexen Basismodelle zu betreiben, die es den Kunden ermöglichen, neue Dienstleistungen und Einnahmequellen zu entdecken und die betriebliche Effizienz zu steigern.

SambaNova Systems mit Hauptsitz in Palo Alto, Kalifornien, wurde 2017 von Branchenkennern sowie Hardware- und Software-Design-Experten von Sun/Oracle und der Stanford University gegründet. Zu den Investoren gehören SoftBank Vision Fund 2, Fonds und Konten, die von BlackRock, Intel Capital, GV, Walden International, Temasek, GIC, Redline Capital, Atlantic Bridge Ventures, Celesta und einigen anderen verwaltet werden. sambanova.ai info@sambanova.ai Linkedin X

Fußnote: Artificial Analysis bietet eine unabhängige Analyse von KI-Sprachmodellen und API-Anbietern. Das Unternehmen bietet Benchmarking und verwandte Informationen, um Menschen und Organisationen bei der Auswahl des richtigen Modells für ihren Anwendungsfall und des entsprechenden Anbieters zu unterstützen.

Die Ausgangssprache, in der der Originaltext veröffentlicht wird, ist die offizielle und autorisierte Version. Übersetzungen werden zur besseren Verständigung mitgeliefert. Nur die Sprachversion, die im Original veröffentlicht wurde, ist rechtsgültig. Gleichen Sie deshalb Übersetzungen mit der originalen Sprachversion der Veröffentlichung ab.

Originalversion auf businesswire.com ansehen: https://www.businesswire.com/news/home/20240529337451/de/

Contacts:

Pressekontakt:

Virginia Jamieson

SambaNova Systems

(650) 279-8619

virginia.jamieson@sambanova.ai